Podržano učenje

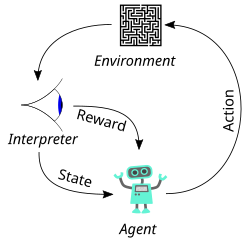

Podržano učenje (енгл. reinforcement learning – RL) područje je mašinskog učenja i optimalne kontrole koje se bavi time kako bi inteligentni agenti trebali odabrati akcije u okruženju kako bi maksimizovali pojam kumulativne nagrade. Podržano učenje jedno je od tri osnovne paradigme mašinskog učenja, uz nadzirano učenje i nenadzirano učenje.

Podržano učenje se razlikuje od nadziranog učenja po tome što ne zahteva prikazivanje označenih ulazno/izlaznih parova, kao ni obavezno ispravljanje suboptimalnih akcija. Umesto toga, fokus je na pronalaženju ravnoteže između istraživanja (nepoznatih područja) i iskorištavanja (trenutnog znanja).[1] Okruženje se obično izražava u obliku Markovljevog procesa odlučivanja (MDP) jer mnogi algoritmi podržanog učenja u ovom kontekstu koriste tehnike dinamičkog programiranja.[2]

Glavna razlika između klasičnih metoda dinamičkog programiranja i algoritama podržanog učenja je da podržano učenje ne pretpostavlja poznavanje tačnog matematičkog modela MDP-a i da cilja na velike MDP-ove za koje tačne metode postaju nemoguće.[3]

Formalizacija problema

[uredi | uredi izvor]Zaleđina

[uredi | uredi izvor]Podržano učenje se uglavnom definiše kao Markovljev proces odlučivanja nazvan po ruskom matematičaru Markovu. Model je koncipiran kao skup stanja koja poseduju sve informacije o sistemu odnosno okolini koje modeluju. Svako od stanja omogućuje što preciznije predviđanje posledica svake izvedene radnje. MDP se formalno zapisuje kao četverac , pri čemu je:

- : množina svih mogućih stanja.

- : množina svih mogućih radnji u svakom stanju.

- : verovatnoća prelaza u stanje , pod pretpostavkom da se nalazimo u stanju i da je izvršena radnja .

- : nagrada / kazna

Strategija

[uredi | uredi izvor]Cilj postupka je pronaći strategiju ponašanja (policy) π: , koja za svako stanje [4]:61 i akciju maksimizira očekivanu buduću nagradu. Strategija se može menjati tokom učenja zavisno od količine dobijenih nagrada.

Postoji nekoliko opcija za odabir akcije, na primer:

- pohlepna: uvek će biti izabrana najbolja akcija -

- ε-pohlepna: uglavnom će biti izabrana najbolja akcija, povremeno sa verovatnoćom ε biće odabrana i nasumična akcija

Vrednost funkcije

[uredi | uredi izvor]Postoje dve slične varijante vrednosti funkcije

- Funkcije vrednosti stanja (state value function)

- Funkcije vrednosti prelaza između stanja (state-action value function)

Funkcije vrednosti definirane su kao alat za traženje maksimalne sume svih očekivanih nagrada pomoću sledećeg algoritma:

- Čekaj nagradu u budućnosti s faktorom umanjenja γ:

- Uvažavajući stanja :

- Uvažavajući prelaze između stanja :

Vidi još

[uredi | uredi izvor]Reference

[uredi | uredi izvor]- ^ Kaelbling, Leslie P.; Littman, Michael L.; Moore, Andrew W. (1996). „Reinforcement Learning: A Survey”. Journal of Artificial Intelligence Research. 4: 237—285. S2CID 1708582. arXiv:cs/9605103

. doi:10.1613/jair.301. Архивирано из оригинала 20. 11. 2001. г.

. doi:10.1613/jair.301. Архивирано из оригинала 20. 11. 2001. г.

- ^ van Otterlo, M.; Wiering, M. (2012). Reinforcement learning and markov decision processes. Reinforcement Learning. Adaptation, Learning, and Optimization. 12. стр. 3—42. ISBN 978-3-642-27644-6. doi:10.1007/978-3-642-27645-3_1.

- ^ Li, Shengbo (2023). Reinforcement Learning for Sequential Decision and Optimal Control (First изд.). Springer Verlag, Singapore. стр. 1—460. ISBN 978-9-811-97783-1. S2CID 257928563. doi:10.1007/978-981-19-7784-8.

- ^ „Reinforcement learning: An introduction” (PDF). Архивирано из оригинала (PDF) 12. 7. 2017. г. Приступљено 2. 4. 2023.

Literatura

[uredi | uredi izvor]- Auer, Peter; Jaksch, Thomas; Ortner, Ronald (2010). „Near-optimal regret bounds for reinforcement learning”. Journal of Machine Learning Research. 11: 1563—1600.

- Busoniu, Lucian; Babuska, Robert; De Schutter, Bart; Ernst, Damien (2010). Reinforcement Learning and Dynamic Programming using Function Approximators. Taylor & Francis CRC Press. ISBN 978-1-4398-2108-4.

- François-Lavet, Vincent; Henderson, Peter; Islam, Riashat; Bellemare, Marc G.; Pineau, Joelle (2018). „An Introduction to Deep Reinforcement Learning”. Foundations and Trends in Machine Learning. 11 (3–4): 219—354. Bibcode:2018arXiv181112560F. S2CID 54434537. arXiv:1811.12560

. doi:10.1561/2200000071.

. doi:10.1561/2200000071. - Powell, Warren (2011). Approximate dynamic programming: solving the curses of dimensionality. Wiley-Interscience. Архивирано из оригинала 31. 7. 2016. г. Приступљено 2. 4. 2023.

- Sutton, Richard S. (1988). „Learning to predict by the method of temporal differences”. Machine Learning. 3: 9—44. doi:10.1007/BF00115009

. Архивирано из оригинала 30. 3. 2017. г. Приступљено 2. 4. 2023.

. Архивирано из оригинала 30. 3. 2017. г. Приступљено 2. 4. 2023. - Szita, Istvan; Szepesvari, Csaba (2010). „Model-based Reinforcement Learning with Nearly Tight Exploration Complexity Bounds” (PDF). ICML 2010. Omnipress. стр. 1031—1038. Архивирано из оригинала (PDF) 14. 7. 2010. г.

- Sutton, Richard S.; Barto, Andrew G. (2018). Reinforcement Learning: An Introduction (2nd изд.). MIT Press. ISBN 978-0-262-03924-6.

- Li, Shengbo Eben (2023). Reinforcement Learning for Sequential Decision and Optimal Control (1st изд.). Springer Verlag, Singapore. ISBN 978-9-811-97783-1. doi:10.1007/978-981-19-7784-8.

- Bertsekas, Dimitri P. (2023). REINFORCEMENT LEARNING AND OPTIMAL CONTROL (1st изд.). Athena Scientific. ISBN 978-1-886-52939-7.

- Annaswamy, Anuradha M. (3. 5. 2023). „Adaptive Control and Intersections with Reinforcement Learning”. Annual Review of Control, Robotics, and Autonomous Systems (на језику: енглески). 6 (1): 65—93. ISSN 2573-5144. S2CID 255702873. doi:10.1146/annurev-control-062922-090153

.

.

Spoljašnje veze

[uredi | uredi izvor]- Reinforcement Learning Repository

- Reinforcement Learning and Artificial Intelligence (RLAI, Rich Sutton's lab at the University of Alberta)

- Autonomous Learning Laboratory (ALL, Andrew Barto's lab at the University of Massachusetts Amherst)

- Real-world reinforcement learning experiments Архивирано 2018-10-08 на сајту Wayback Machine at Delft University of Technology

- Stanford University Andrew Ng Lecture on Reinforcement Learning

- Dissecting Reinforcement Learning Series of blog post on reinforcement learning with Python code

- A (Long) Peek into Reinforcement Learning